Gerando imagens com Stable Diffusion e IA na Alura

Não é novidade que, no último ano, a inteligência artificial (IA) tem feito avanços significativos em diversas áreas, em especial na geração de imagens.

Nessa perspectiva, o Stable Diffusion se destaca como uma ferramenta inovadora para gerar imagens através de inteligência artificial.

Neste artigo, vamos explorar o que é o Stable Diffusion, como ele funciona, quais são suas aplicações e quais os possíveis impactos em UX e Design.

O que é o Stable Diffusion?

O Stable Diffusion é um modelo de geração de imagens baseado em técnicas de aprendizado profundo.

Desenvolvido pela Stability AI, esse modelo usa uma abordagem chamada de "difusão estável" para criar imagens de alta qualidade a partir de descrições textuais.

Diferente de outros modelos que apenas geram imagens, o Stable Diffusion permite um controle mais refinado sobre o processo de criação. O resultado disso são imagens mais coerentes e com mais detalhes.

Como funciona o Stable Diffusion?

A técnica de difusão se inspira em processos físicos de difusão de partículas, em que uma substância se espalha de uma região de alta concentração para uma de baixa concentração.

No contexto da geração de imagens, o modelo começa com uma imagem ruidosa (semelhante à estática de TV) e, por meio de várias etapas, remove o ruído de maneira controlada até formar uma imagem clara e detalhada.

O funcionamento do Stable Diffusion baseia-se nessa tecnologia de difusão e utiliza um espaço latente, o que reduz significativamente os requisitos de processamento.

Diferente de muitos outros modelos de geração de imagem que utilizam o espaço de pixels da imagem, o Stable Diffusion opta por um espaço latente de definição reduzida.

Isso permite que seja possível executá-lo em desktops ou laptops com GPUs, facilitando bastante o acesso.

Passos a passo do processo de gerar imagens com Stable Diffusion

- Inicialização: O processo começa com uma imagem completamente ruidosa.

- Interpretação do texto: A descrição textual fornecida é interpretada pelo modelo para entender o contexto e os detalhes da imagem desejada.

- Difusão Progressiva: A cada etapa, o modelo ajusta a imagem, reduzindo o ruído e adicionando detalhes com base na interpretação do texto.

- Refinamento: Nas etapas finais, o modelo faz ajustes finos para garantir que a imagem final esteja o mais próximo possível da descrição original.

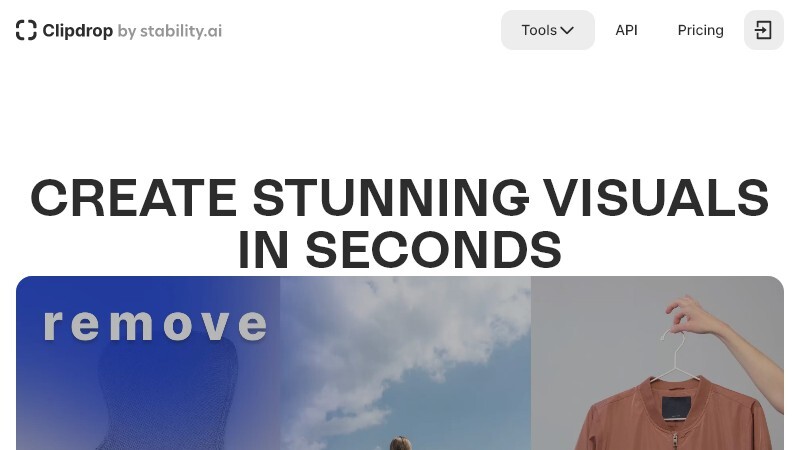

O que é o Clipdrop?

O Clipdrop é um site que cria e edita imagens por meio de Inteligência Artificial, oferecendo uma variedade de funcionalidades para pessoas que querem manipular imagens digitalmente.

Ele permite aos usuários gerar imagens utilizando a versão mais recente do Stable Diffusion, uma tecnologia de IA avançada, sem a necessidade de instalar ou configurar o software localmente.

O site facilita o processo de criação de imagens, permitindo que as pessoas se concentrem em refinar os prompts usados para obter os melhores resultados visuais.

Funcionalidades principais

De forma geral, as principais funcionalidades do Clipdrop são:

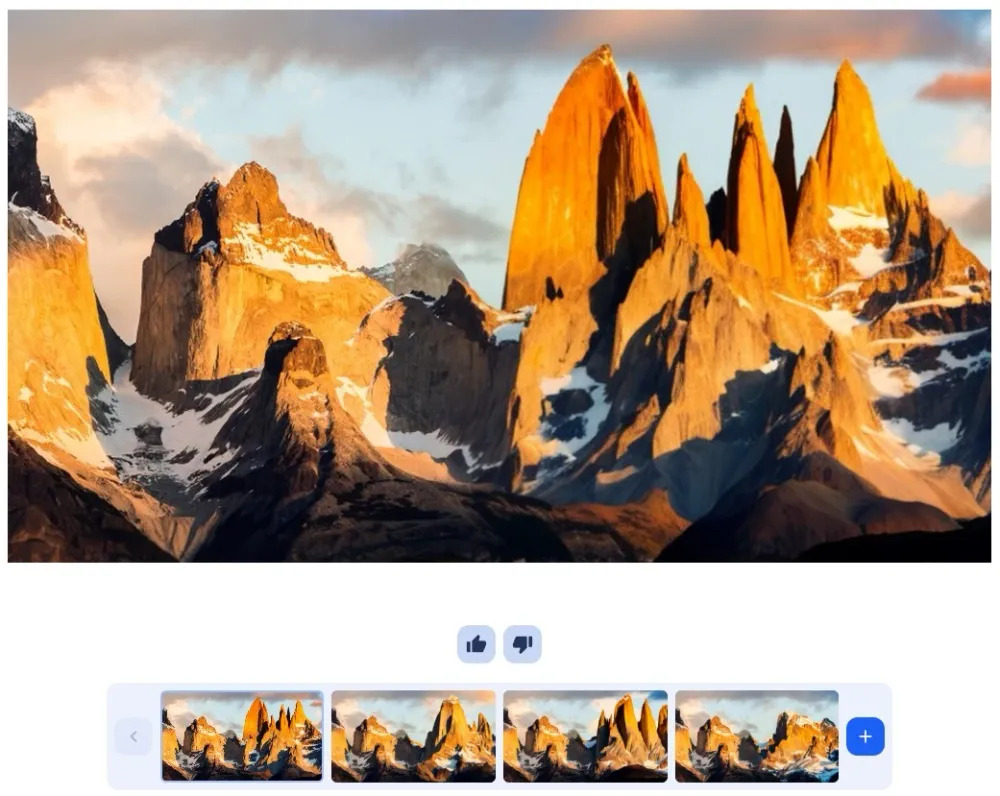

Gerar imagens

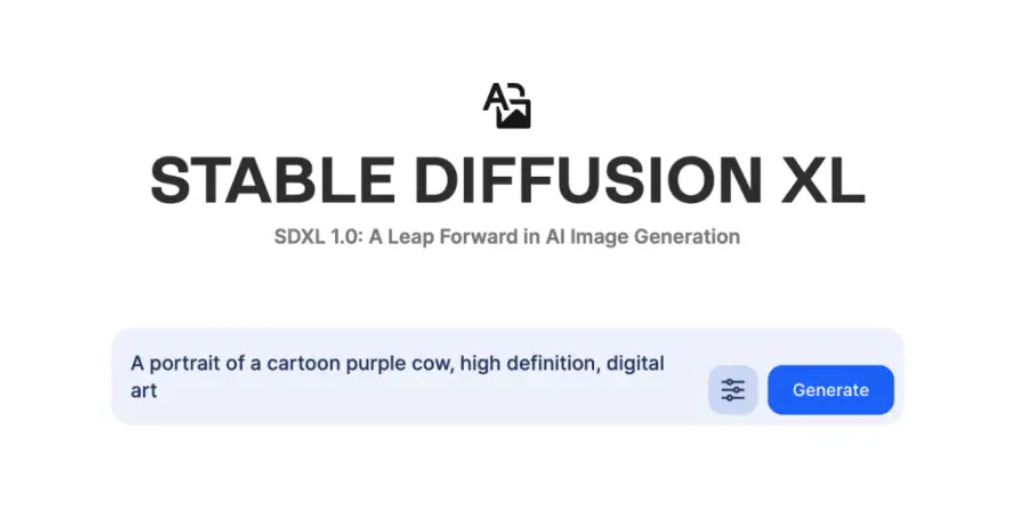

Uma das funcionalidades mais destacadas do Clipdrop é gerar imagens. Através do Stable Diffusion XL, as pessoas podem criar imagens a partir de descrições textuais (prompts).

A plataforma permite ajustar diversos aspectos, como estilo, proporção e remoção de elementos indesejáveis, proporcionando um alto nível de controle sobre o resultado final.

Editar imagens

O Clipdrop oferece uma série de ferramentas robustas para editar imagens, incluindo:

- Remover plano de fundo: Elimina fundos indesejados de imagens, facilitando a criação de composições limpas e profissionais.

- Alterar proporção: Ajusta as proporções das imagens para atender a diferentes necessidades de design.

- Reimaginar fotos: Permite transformar fotos existentes em novas criações visuais.

- Gerar imagens a partir de esboços: Converte desenhos simples em imagens detalhadas.

- Remover objetos, pessoas e texto: Oferece soluções precisas para eliminar elementos indesejados de uma imagem.

- Alterar projeção de iluminação: Ajusta a iluminação das imagens para melhorar a estética visual.

- Upscaling: Aumenta a resolução das imagens para melhor qualidade.

- Alterar plano de fundo: Substitui o plano de fundo das imagens para criar novos contextos visuais.

Limites do Modo Gratuito

No modo gratuito, as imagens geradas pelo Clipdrop vêm com algumas limitações:

- Marca d'água: As imagens geradas apresentam uma marca d'água.

- Resolução Moderada: A resolução final das imagens é moderada.

- Velocidade Reduzida: A velocidade de geração é menor em comparação com o modo pago.

- Restrições de Conteúdo: Há restrições quanto à natureza explícita das imagens geradas.

Como usar o Stable Diffusion online?

Para usar o Stable Diffusion online, você pode seguir os passos abaixo, utilizando o serviço disponível em sites como stablediffusionweb.com ou plataformas específicas como o Dream Studio e o Clipdrop.

Se você quer entender um pouco mais, nesse episódio da websérie ”IAs generativas”, Fabrício Carro explicou como usar o Stable Diffusion online e como gerar imagens por meio de prompts:

https://www.youtube.com/watch?v=ToprOnzWkPA&list=PLh2Y_pKOa4Ud316ih975nbh3YbF5R4uZP&index=13

Guia de prompts para Stable Diffusion

Para criar prompts eficazes no Stable Diffusion, é crucial seguir algumas diretrizes específicas que maximizam a capacidade do modelo de IA de gerar imagens que correspondam ao que você deseja.

Aqui está um guia simplificado baseado nas informações fornecidas:

Estrutura Básica dos Prompts

- Forma Ideal: Uma boa estrutura para um prompt no Stable Diffusion segue esta forma: "Uma [tipo de imagem] de um [assunto principal], [pistas de estilo]*".

- Tipos de Imagem: Pode incluir "ilustração digital", "pintura a óleo", "pintura mate", "render 3D", "mapa medieval".

- Assunto Principal: Deve ser composto principalmente por adjetivos e substantivos, evitando verbos, pois o Stable Diffusion tem dificuldades em interpretá-los corretamente. Mantenha o assunto principal simples, preferencialmente com um ou dois elementos principais.

- Pistas de Estilo: Podem variar bastante, mas é recomendado não adicionar muitas, talvez apenas 1 a 3. Boas pistas de estilo podem incluir "arte conceitual", "steampunk", "trending em artstation", "boa composição", "hiperrealista", "óleo sobre tela", "cores vívidas".

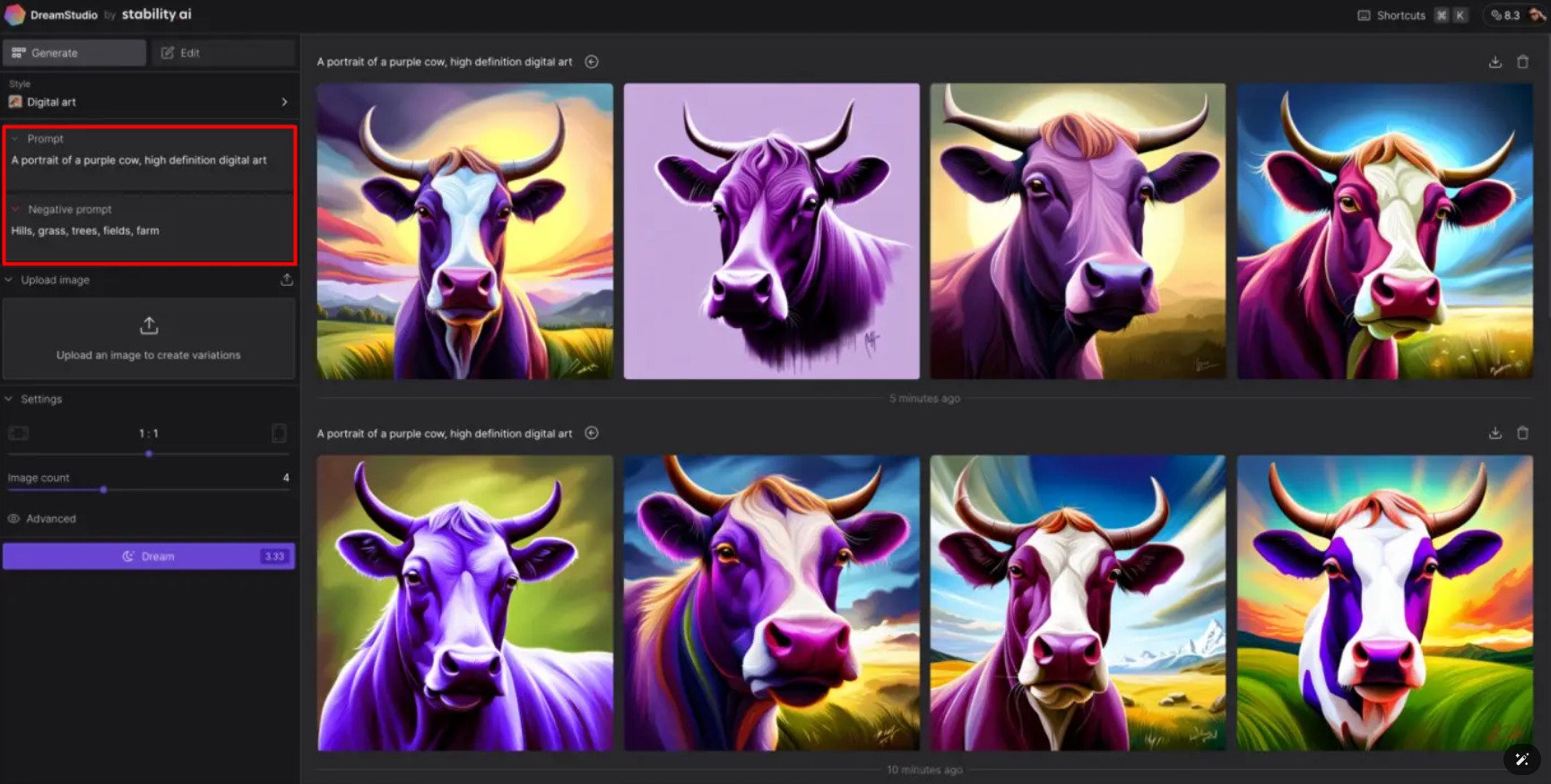

Como destacado na imagem anterior, usar prompts negativos é outra ótima maneira de orientar a imagem, mas em vez de colocar o que você quer, você coloca o que não quer.

Eles não precisam ser objetos. Eles também podem ser estilos e atributos indesejados, por exemplo, feio e deformado.

Dicas de como escrever prompts para o Stable Diffusion

Para escrever prompts eficazes para o Stable Diffusion, é essencial seguir algumas diretrizes e técnicas que maximizam a capacidade do modelo de IA de gerar imagens que correspondam ao que você deseja. Aqui estão algumas dicas:

Escreva em inglês

Ao escrever prompts para o Stable Diffusion em inglês, é crucial seguir algumas estratégias para garantir que você obtenha os melhores resultados possíveis.

Ser o mais específico possível é fundamental; por exemplo, em vez de apenas "gatos", especifique "gatos cinzentos" para obter imagens de gatos dessa cor específica.

Considere a construção de prompts como um processo iterativo, começando com uma descrição básica e refinando-a com base nos resultados obtidos.

Isso pode envolver a adição de mais detalhes, a exclusão de termos que não estão funcionando ou a modificação de palavras-chave para direcionar o resultado desejado.

Descreva com detalhes

Para criar prompts eficazes no Stable Diffusion, é essencial seguir alguns passos fundamentais. Primeiro, especifique com detalhes, certificando-se de que seu prompt seja claro e preciso, evitando termos genéricos ou imprecisos.

Isso é crucial para direcionar o modelo a gerar imagens que estejam mais alinhadas com o que você busca.

Em seguida, explore diferentes palavras-chave e frases, observando como cada mudança influencia a saída. Pequenas alterações podem levar a grandes diferenças nos resultados.

Utilize prompts negativos para evitar características indesejadas nas imagens, sendo claro sobre o que você não quer ver na imagem.

Considere a criação de prompts como um processo contínuo de aprendizado e adaptação, praticando e ajustando seus prompts com base nas respostas do modelo, tratando essa tarefa como tanto uma arte quanto uma ciência.

Esteja ciente do limite de tokens para cada prompt. Se necessário, divida seu prompt em partes menores para garantir que todas as informações importantes sejam incluídas dentro do limite, o que pode exigir algum planejamento e organização.

Seguindo essas diretrizes, você estará preparado para elaborar prompts que maximizem a capacidade do Stable Diffusion de gerar imagens que atendam exatamente às suas expectativas.

Tenha atenção às contradições

Ao escrever prompts para o Stable Diffusion, é crucial estar atento às contradições, pois elas podem levar a resultados insatisfatórios na arte gerada pela IA, frequentemente causando frustração e decepção.

Evitar palavras vagas ou conflitantes que confundem o modelo de IA é essencial, pois isso pode levar a imagens imprecisas ou sem sentido.

Prompts mal formuladas podem resultar em imagens chatas e pouco interessantes, devido à falta de detalhes que sufocam o potencial criativo da IA.

Além disso, prompts impossíveis de visualizar ou intrinsecamente desagradáveis podem levar a imagens de baixa qualidade ou engajadoras.

Também é importante evitar prompts que propaguem informações incorretas ou desencorajem a exploração e o aprendizado, pois podem levar a imagens enganosas ou sem inspiração.

Para otimizar sua experiência com o Stable Diffusion e a geração de arte IA, concentre-se na elaboração de bons prompts que sejam claros, específicos, criativos, versáteis e educacionais.

Evite as armadilhas de prompts vagos, contraditórios, irreais ou desencorajadores. Lembre-se, a qualidade do prompt influencia muito a qualidade da arte.

Background: como remover o fundo da imagem?

Para remover o fundo de uma imagem usando o Clipdrop, você pode seguir os passos abaixo, aproveitando tanto a interface web quanto a API pública oferecida pelo serviço.

Aqui está um guia detalhado:

Usando a Interface Web do Clipdrop

- Visite o Site Clipdrop: Acesse o site clipdrop.co e navegue até a seção de remoção de fundo.

- Faça Upload da Imagem: Clique no botão para fazer upload da imagem cujo fundo você deseja remover. Você pode arrastar e soltar a imagem ou clicar no botão para selecionar arquivos do seu dispositivo.

- Escolha o Tipo de Fundo: Selecione o tipo de fundo que deseja para a imagem após o fundo ter sido removido. As opções podem incluir fundo transparente, branco, ou escolher um fundo personalizado.

- Download da Imagem: Após a remoção do fundo, baixe a imagem processada para o seu dispositivo.

Usando a API do Clipdrop para Remover o Fundo

Se você está desenvolvendo uma aplicação ou precisa automatizar o processo, pode utilizar a API do Clipdrop para remover o fundo de imagens.

- Obtenha uma Chave de API: Primeiro, você precisa registrar-se no Clipdrop e obter uma chave de API.

- Prepare a Solicitação: Use o método POST para enviar a imagem para a API. A solicitação deve ser enviada para https://apis.clipdrop.co/remove-background/v1 com o cabeçalho 'x-api-key': YOUR_API_KEY.

- Envie a Imagem: No corpo da solicitação, inclua o arquivo da imagem como um campo multipart/form-data com o nome image_file.

- Trate a Resposta: A API retornará uma representação binária da imagem com o fundo removido. Você pode então salvar ou manipular essa imagem conforme necessário.

Exemplo de Código para a API

fetch('https://apis.clipdrop.co/remove-background/v1', {

method: 'POST',

headers: {

'x-api-key': 'SUA_CHAVE_API',

},

body: form, // 'form' deve conter o campo 'image_file' com a imagem

})

.then(response => response.arrayBuffer())

.then(buffer => {

// 'buffer' aqui é uma representação binária da imagem retornada

});

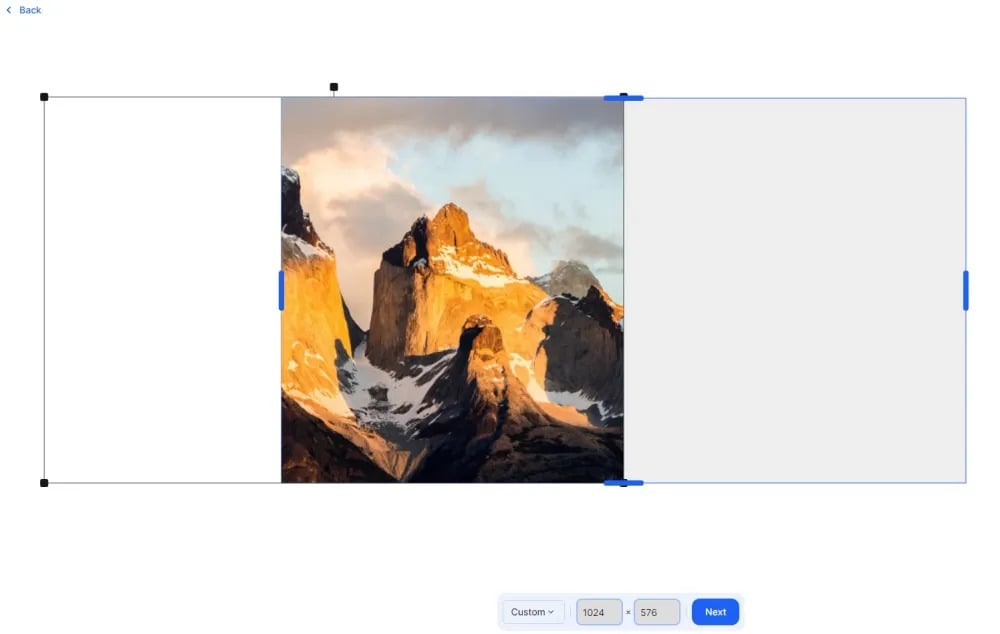

Uncrop: como autocompletar uma imagem

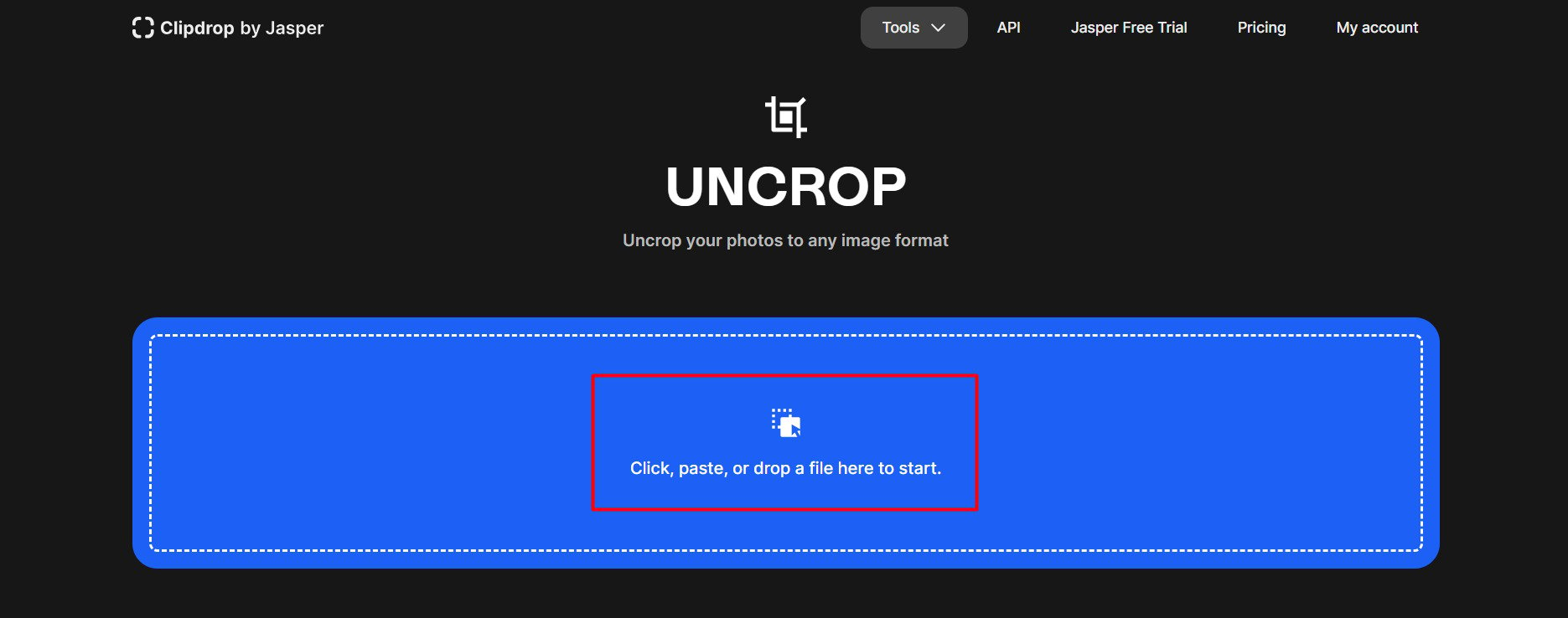

Para autocompletar uma imagem no Stable Diffusion usando o recurso Uncrop, siga os passos abaixo.

O Uncrop é uma ferramenta otimizada para editar a proporção de aspecto das imagens, permitindo que você expanda ou encontre automaticamente a parte perdida de uma imagem cortada, mantendo a integridade do conteúdo original.

Passos para Usar o Uncrop

- Acesse o Site do Clipdrop: Visite o site clipdrop.co/uncrop para acessar a ferramenta Uncrop.

- Carregue a Imagem: Clique no botão "Click, paste, or drop a file here to start." e selecione a imagem que deseja autocompletar. Você pode carregar a imagem diretamente do seu dispositivo ou copiar e colar o link da imagem.

- Defina a Nova Proporção de Aspecto: Se você sabe a proporção de aspecto desejada para a imagem completa, insira-a nos campos fornecidos. Caso contrário, deixe o campo padrão e o Uncrop tentará preencher automaticamente a imagem com base em padrões comuns.

- Gerar a Imagem Autocompletada: Clique no botão para iniciar o processo de geração. O Uncrop analisará a imagem e gerará uma versão autocompletada que corresponde à nova proporção de aspecto especificada.

- Visualize e Baixe a Imagem: Após a geração, visualize a imagem autocompletada. Se estiver satisfeito com o resultado, baixe a imagem para o seu dispositivo.

Usando o Uncrop, você pode facilmente expandir ou completar imagens cortadas, preservando a essência do conteúdo original e adaptando-o às suas necessidades específicas de proporção de aspecto.

Cursos de inteligência artificial da Alura

Se você chegou até aqui, quer dizer que possui interesse em conhecer as IAs que estão se destacando no mercado e quem sabe se tornar uma pessoa especialista na área.

Para isso, acesse gratuitamente as primeiras aulas dos cursos feitos pela Escola de Inteligencia Artificial da Alura e continue aprendendo sobre temas como:

- Inteligência artificial Generativa: Midjourney e ChatGPT

- IA no Photoshop: criando e editando imagens

- Design e Inteligência Artificial: otimizando o processo criativo

- Inteligência Artificial e UX: otimize a construção de um produto digital

- Ux Research: utilizando IA na pesquisa com usuário

- Como aprender melhor? Com Diogo Pires | #HipstersPontoTube

Conclusão

Integrando a avançada tecnologia do Stable Diffusion, o Clipdrop transforma radicalmente a maneira como criamos e editamos imagens.

Sua capacidade de converter descrições textuais em imagens detalhadas e de alta qualidade, operando em um espaço latente que reduz significativamente os requisitos de processamento, democratiza o acesso a ferramentas de design sofisticadas.

Isso não só acelera os processos criativos, mas também torna essas tecnologias mais acessíveis a profissionais e entusiastas que utilizam dispositivos comuns, ampliando as possibilidades criativas de maneira inédita.

Agora que você conhece mais sobre o Stable Diffusion, convido você a explorar o uso da IA na geração e edição de imagens.