XAI – IA explicável: tudo sobre a Inteligência Artificial explicável

Você já parou para pensar em como um algoritmo decide se você deve receber um empréstimo ou qual tratamento médico é o mais indicado para o seu caso? Por muito tempo, a resposta da tecnologia foi: "é complexo demais para explicar".

Entrávamos na era da "caixa-preta", em que as redes neurais tomavam decisões brilhantes, mas totalmente opacas.

No entanto, à medida que a IA avança sobre setores críticos como saúde, finanças e segurança pública, o "porque sim" deixou de ser aceitável.

É aqui que surge a XAI – IA explicável (do inglês Explainable AI ou simplesmente Inteligência Artificial Explicável).

Neste guia, vamos nos aprofundar na tecnologia que está abrindo as engrenagens da inteligência artificial.

Por aqui, exploraremos a diferença entre os modelos tradicionais e explicáveis, as técnicas que permitem rastrear o raciocínio das máquinas e como figuras como Elon Musk estão movimentando esse mercado com a startup xAI.

O que é a XAI?

A XAI, ou IA Explicável, é um conjunto de métodos e processos que permite aos usuários humanos compreenderem, confiarem e gerenciarem os resultados gerados por algoritmos de machine learning.

Para entender a XAI, precisamos primeiro entender o problema da "caixa-preta".

Essa é uma questão que tem crescido junto com o avanço dos grandes modelos de linguagem: modelos de deep learning são frequentemente tão complexos que nem mesmo os engenheiros que os criaram conseguem explicar exatamente por que uma entrada X resultou na saída Y.

A XAI busca "acender a luz" dentro dessa caixa, fornecendo uma justificativa lógica para cada decisão.

Antes de avançarmos… só uma distinção importante: XAI vs. xAI

É comum haver confusão entre a sigla do conceito técnico XAI – IA explicável e a empresa de Elon Musk. Vamos esclarecer:

- XAI (Conceito): Refere-se à transparência algorítmica. É uma disciplina da ciência da computação.

- xAI (Empresa): É a startup de IA fundada por Elon Musk em 2023. Criadora do chatbot Grok, a empresa agora se fundiu à X Corp (antigo Twitter) para criar uma plataforma unificada que utiliza os dados da rede social para treinar modelos de inteligência conversacional avançada.

Neste artigo, portanto, tenha em mente que focaremos no conceito técnico de explicabilidade, sem perder de vista como o mercado de IA e empresas como a de Musk estão moldando essa tendência.

Por que a XAI é relevante no cenário atual?

A compreensão da decisão é o elo humano da XAI, permitindo que especialistas auditem e validem o raciocínio por trás dos modelos de machine learning.

O mercado de tecnologia vive uma explosão da IA generativa. No entanto, com o aumento de escala dos projetos envolvendo inteligência artificial, vêm grandes responsabilidades e riscos.

Nesse sentido, a relevância da disciplina da XAI – IA explicável se dá por três pilares fundamentais:

- Confiança e segurança: Se um sistema de direção autônoma toma uma decisão brusca, precisamos saber o porquê para evitar falhas futuras.

- Conformidade regulatória: Leis como a LGPD no Brasil e o AI Act na Europa exigem que decisões automatizadas que afetam cidadãos possam ser explicadas e contestadas.

- Ética e justiça: Algoritmos podem herdar vieses humanos presentes nos dados de treinamento. A XAI – IA explicável é a ferramenta que nos permite auditar esses modelos para garantir que não haja discriminação por raça, gênero ou idade.

A explicabilidade não é apenas um "recurso extra"; ela é a base para a inovação responsável em larga escala.

Como funciona a XAI?

Diferentemente dos modelos tradicionais, a XAI implementa uma camada de interpretação, ou seja, enquanto um modelo padrão foca apenas na precisão (acertar o resultado), a XAI busca o equilíbrio entre desempenho e interpretabilidade.

E qual a diferença entre IA e XAI?

A IA comum foca no resultado. Ela recebe milhões de variáveis e entrega uma probabilidade. Já a XAI foca no processo. Ela gera "mapas de importância" que mostram quais variáveis foram determinantes para aquela conclusão específica.

Exemplo: Em um diagnóstico médico, a IA comum diria: "98% de chance de ser pneumonia". A XAI diria: "Identifiquei pneumonia devido à opacidade na região X do pulmão e à frequência respiratória Y".

Técnicas da XAI

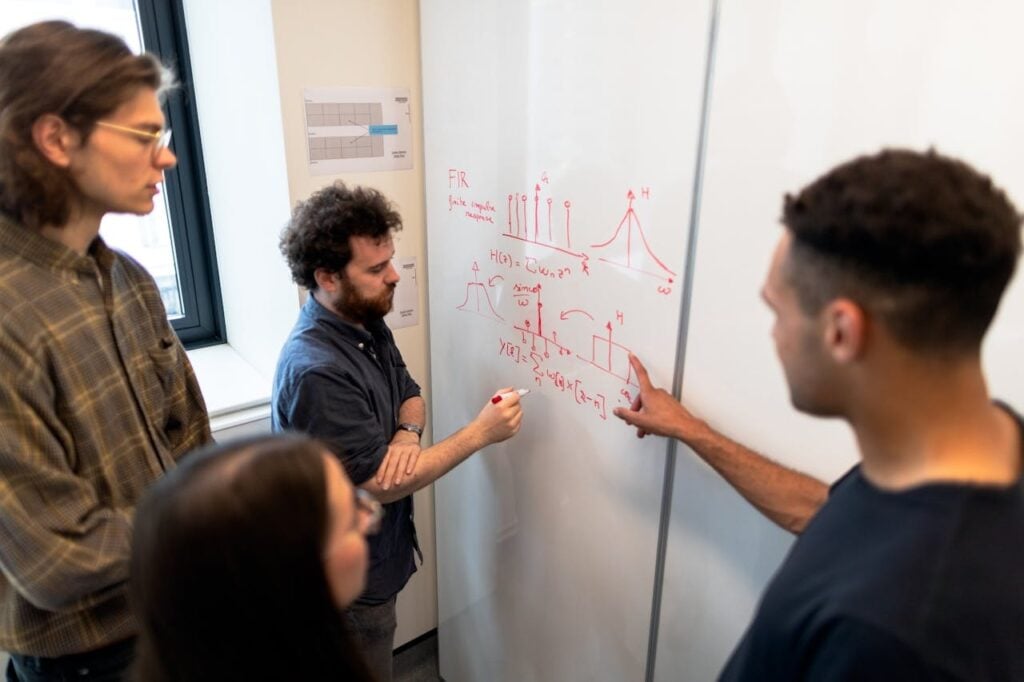

Para tornar um algoritmo explicável, os cientistas de dados utilizam técnicas específicas que traduzem a matemática complexa em algo compreensível para humanos.

Precisão da previsão

Aqui, o objetivo é garantir que a explicação corresponda à realidade do modelo. A técnica mais famosa é o LIME (Local Interpretable Model-Agnostic Explanations).

O LIME cria versões simplificadas do modelo ao redor de uma previsão específica para entender como pequenas mudanças nos dados de entrada mudariam o resultado.

Rastreabilidade

A rastreabilidade permite "rebobinar" o processo decisório.

Um exemplo é o DeepLIFT, que analisa a ativação de cada neurônio em uma rede neural profunda, comparando-o a um ponto de referência. Isso mostra a contribuição exata de cada camada para o resultado final.

Compreensão da decisão

Este é o fator humano. Não basta o sistema disparar um gráfico técnico, a interface deve ser intuitiva para que um médico, juiz ou gerente financeiro possa tomar uma ação baseada naquela informação.

Dá para dizer assim que a disciplina da XAI – IA explicável foca em transformar dados em narrativa.

Desafios e oportunidades da XAI

Apesar de essencial, a XAI enfrenta o "Trade-off da Interpretabilidade". Geralmente, quanto mais explicável é um modelo (como uma árvore de decisão simples), menos preciso ele é para problemas massivos.

Por outro lado, modelos ultra-precisos (como redes neurais gigantes) são os mais difíceis de explicar.

Mas, ainda com esses desafios, no horizonte existem grandes oportunidades:

- Um exemplo são as startups de auditoria que estão surgindo, essas são empresas focadas apenas em auditar IAs de terceiros.

- Outro caso interessante é o da IA Industrial, já que fábricas e sistemas de energia críticos só adotarão IA plenamente quando houver garantia de que o operador humano entende o controle da máquina.

O futuro da Inteligência Artificial com a XAI

O futuro da tecnologia aponta para uma colaboração homem-máquina mais estreita.

Com o avanço de iniciativas como o Grok (da xAI de Musk), do Claude (da Anthropic), do Gemini (do Google) e do ChatGPT (da OpenAI), a tendência é que a IA não apenas responda, mas "pense alto", compartilhando suas incertezas e raciocínios com o usuário em tempo real.

A explicabilidade será o componente que permitirá a transição de ferramentas que "fazem coisas por nós" para parceiros que "pensam conosco".

Impacto social e ético da XAI e IA responsável

A ética em IA é o grande tema da década. Sem explicabilidade, a IA responsável é impossível.

Se não podemos explicar como um modelo de contratação escolheu os candidatos, não podemos garantir que ele não está sendo racista ou machista de forma velada.

A XAI visa a implementação de uma "IA de vidro", onde a transparência mitiga riscos de reputação e evita, por exemplo, processos judiciais onerosos por decisões algorítmicas enviesadas.

Benefícios da XAI – IA explicável

Entre os benefícios que podemos observar nesse campo prático da pesquisa em inteligência artificial, temos:

- Auditabilidade: Facilita a inspeção por órgãos reguladores.

- Melhoria do modelo: Ao entender por que o modelo errou, os desenvolvedores podem corrigir o erro na raiz (dados ou lógica).

- Confiança do usuário: Clientes aceitam melhor uma negativa (como de um cartão de crédito) quando recebem os motivos claros.

- Redução de custos: Menos tempo gasto tentando "adivinhar" falhas em modelos obscuros.

Boas práticas para usar XAI e ter bons resultados

Para implementar XAI com sucesso em sua organização ou projeto de aprendizado de máquina, procure seguir estas diretrizes:

Remoção de vieses

Não espere o modelo ficar pronto para testar a justiça. Use ferramentas de XAI desde a fase de treinamento para identificar se o modelo está dando peso excessivo a variáveis protegidas (como CEP, etnia ou gênero).

Mitigação do desvio do modelo (Data Drift)

O mundo muda, e os dados também. Um modelo treinado antes da pandemia pode não funcionar bem em 2026.

A XAI também ajuda a identificar quando o modelo começa a decidir com base em padrões que não existem mais ou mesmo quando começa a desviar da cadeia de decisões esperadas da qual foi treinado para atuar.

Gerenciamento de riscos do modelo

Sempre implemente alertas automáticos que contribuam na revisão de fluxo. Se a explicabilidade de uma decisão cair abaixo de um nível de confiança, o sistema deve solicitar uma revisão humana obrigatória.

Automação do ciclo de vida

Use plataformas que unifiquem a construção, o monitoramento e a explicação. A automação garante que cada versão do modelo seja documentada e explicável desde o "nascimento".

Prontidão na multinuvem

A arquitetura de XAI deve ser flexível para rodar em nuvens híbridas (públicas e privadas).

Isso garante que dados sensíveis possam ser processados localmente enquanto se aproveita o poder de processamento da nuvem para as explicações.

Casos de uso para IA explicável

Abrir a "caixa-preta" das redes neurais permite rastrear como os dados fluem entre as conexões para gerar uma resposta ética e responsável.

A implementação da IA explicável não é apenas uma questão ética; é um requisito estratégico em setores onde o custo do erro é extremamente alto. Ao abrir a "caixa-preta", as organizações podem acelerar a adoção de modelos complexos em ambientes regulados.

Saúde e segurança no diagnóstico

No setor de saúde, a XAI é utilizada para acelerar diagnósticos e melhorar a análise de imagens médicas, como tomografias e exames de retina.

- Transparência Clínica: Em vez de apenas receber um alerta de patologia, o médico pode visualizar quais pixels ou padrões na imagem motivaram a decisão da IA, garantindo maior rastreabilidade no cuidado ao paciente..

- Setor Farmacêutico: A explicabilidade auxilia na agilização do processo de aprovação de novos medicamentos, fornecendo evidências claras sobre como os algoritmos de triagem molecular chegaram a determinados resultados..

Serviços financeiros

O setor financeiro utiliza a XAI para transformar processos tradicionalmente opacos em jornadas transparentes para o cliente, como na aprovação de crédito e na gestão de patrimônio.

Justiça criminal

O uso de algoritmos na justiça exige uma vigilância constante contra o viés, principalmente olhando para:

- Avaliação de riscos: A XAI é aplicada na análise da população carcerária e na previsão de riscos de reincidência, garantindo que o magistrado possa auditar quais os dados de treinamento pesaram na decisão..

- Detecção de vieses: Ferramentas explicáveis permitem identificar se o algoritmo está utilizando variáveis discriminatórias de forma indireta, promovendo um sistema jurídico mais justo e transparente..

E-commerce e experiência do usuário

A explicabilidade melhora diretamente a experiência de consumo ao transformar recomendações em diálogos lógicos, sendo uma ferramenta interessante para recomendações inteligentes ao cliente e na precificação dinâmica de produtos para as empresas.

Como aprender mais sobre inteligência artificial

A jornada pela inteligência artificial é um caminho sem volta para quem deseja liderar a transformação digital. Entender a técnica é importante, mas saber aplicá-la com responsabilidade e visão de mercado é o que define os grandes profissionais.

Na Alura, preparamos você para dominar desde os fundamentos de lógica e Python até a criação de modelos complexos de aprendizado de máquina.

As Carreiras Alura focam na prática, ajudando você a construir portfólio e entender os desafios reais do dia a dia.

Na carreira de Engenharia de IA, por exemplo, você aprende a criar, implantar e monitorar soluções inteligentes de ponta a ponta

A IA está redesenhando o mundo. A pergunta é: você será quem olha para a caixa-preta ou quem tem as chaves para abri-la?

Gostou deste conteúdo? Fixe o seu conhecimento de verdade! Publique seu maior insight sobre XAI no LinkedIn ou X (antigo Twitter), marque a Alura e use a hashtag #AprendinoBlogdaAlura. Queremos acompanhar sua evolução!

FAQ | Perguntas frequentes sobre XAI – IA explicável

Você ainda ficou com algumas dúvidas depois do conteúdo? Calma, confira abaixo as mais frequentes!

O que significa a sigla XAI?

XAI significa Explainable Artificial Intelligence, ou Inteligência Artificial Explicável em português.

Qual a relação de Elon Musk com a XAI?

Musk fundou a empresa xAI (com 'x' minúsculo), que foca em criar IAs avançadas como o Grok. Embora o nome seja similar à sigla técnica XAI, o foco da empresa de Musk é a busca por uma "IA que entenda o universo", enquanto a disciplina XAI foca em transparência e ética.

Por que a IA é chamada de "caixa-preta"?

Porque em modelos complexos de redes neurais, as conexões matemáticas são tantas que é impossível para um humano rastrear o caminho lógico que levou a um resultado específico.

A XAI diminui a performance dos modelos?

Em alguns casos, sim. Existe um desafio técnico em manter a alta precisão de modelos complexos enquanto se extrai explicações simples. O objetivo da pesquisa atual é minimizar essa perda.