Pipeline de IA: entenda a infraestrutura por trás da inteligência artificial

Você já deve concordar que a inteligência artificial, hoje, está no centro de produtos digitais de alta performance. No entanto, o que vemos na interface de um aplicativo, como uma recomendação precisa de filme ou a resposta instantânea de um assistente virtual, é apenas a ponta de um iceberg de infraestrutura bem complexo.

Isso porque, para que uma IA funcione de forma confiável, escalável e segura, ela depende de uma estrutura invisível, porém rigorosa, chamada pipeline de IA.

Neste artigo vamos juntos explorar o conceito, os componentes e a importância estratégica desses fluxos de trabalho com inteligência artificial para o desenvolvimento de software e a ciência de dados contemporânea.

O que é um pipeline de IA?

Basicamente, um pipeline de IA é uma sequência sistemática e automatizada de etapas que transforma dados brutos em decisões inteligentes ou previsões úteis.

Para fins mais didáticos, podemos compará-lo a uma linha de montagem industrial: em uma extremidade, entram as matérias-primas (dados brutos); ao longo da linha, ocorrem diversas transformações e testes; e, na outra extremidade, sai um produto acabado (um modelo de inteligência artificial pronto para uso).

Diferente de um código estático tradicional, um pipeline de IA é um sistema mais dinâmico.

Ele não é construído uma única vez, mas desenhado para ser executado repetidamente, garantindo que o modelo aprenda com novos dados e se mantenha atualizado conforme a realidade do mundo muda.

Sem um pipeline bem estruturado, o desenvolvimento de IA torna-se um processo manual, propenso a erros e impossível de escalar em um ambiente corporativo.

Componentes de um pipeline de IA

Para compreendermos a profundidade desta infraestrutura, é necessário detalhar cada um dos seus pilares fundamentais. Cada componente exerce uma função crítica para garantir a integridade do resultado final:

3. Ingestão de dados

A primeira etapa consiste em coletar e importar informações de fontes variadas. Essas fontes podem ser internas (como os bancos de dados transacionais, logs de servidores, perfis de usuários) ou externas (sejam APIs de terceiros, dados públicos ou sensores de dispositivos).

E esse processo pode ocorrer das seguintes formas:

- Batch (em lote): é o processamento de grandes volumes de dados em intervalos programados.

- Streaming (em tempo real): é a ingestão contínua de dados conforme eles são gerados, essencial para sistemas que exigem respostas imediatas, como detecção de fraudes financeiras.

2. Qualidade e governança de dados

Outro aspecto importante da pipeline de IA está gestão de qualidade dos dados. Dados de baixa qualidade geram modelos de baixa qualidade, um conceito que é conhecido como Garbage In, Garbage Out.

Nesta fase, aplicam-se regras de governança para assegurar a linhagem de dados (saber de onde o dado veio e como foi alterado) e a conformidade com leis como a LGPD (Lei Geral de Proteção de Dados).

A governança garante que apenas dados autorizados e éticos alimentem o sistema.

3. Pré-processamento e engenharia de variáveis

Os dados brutos raramente estão prontos para o aprendizado. Eles podem conter valores ausentes, erros de digitação ou formatos incompatíveis.

O pré-processamento limpa e normaliza essas informações. Já a engenharia de variáveis (feature engineering) é o processo de selecionar e transformar os dados brutos em características que o modelo consiga interpretar melhor.

Por exemplo, converter uma data de nascimento na variável "idade" para facilitar uma análise de risco.

4. Treinamento, validação e avaliação

Aqui, o algoritmo de aprendizado de máquina processa os dados preparados. O processo é dividido em três subetapas:

- Treinamento: O modelo busca padrões nos dados.

- Validação: Ajustam-se os parâmetros internos do modelo para melhorar o desempenho.

- Avaliação: O modelo é testado com dados que ele nunca viu antes para verificar se ele realmente aprendeu a generalizar ou se apenas "decorou" os exemplos (problema conhecido como overfitting).

5. Serialização, implantação e operações de ML

Após o treinamento, o modelo precisa ser "empacotado" (serializado) em um formato que o software de produção consiga ler.

Esta etapa faz parte do MLOps (Machine Learning Operations), que utiliza práticas de CI/CD (Integração Contínua e Entrega Contínua) para garantir que a transição do ambiente de pesquisa para o ambiente de uso real seja automática e segura.

6. Monitoramento, atualização e governança de modelos

E o trabalho não termina com o lançamento. É necessário monitorar o desempenho do modelo 24 horas por dia. Isso porque dois problemas comuns que devem ser monitorados são:

- O data drift: que é quando as características dos dados que entram no sistema mudam (ex: uma mudança no comportamento de consumo pós-pandemia).

- E o model drift: quando o modelo perde a precisão porque o mundo ao redor mudou. Quando isso ocorre, o pipeline reinicia automaticamente o ciclo de treinamento.

7. Reprodutibilidade, versionamento e documentação

Em engenharia de software, versionamos o código como uma forma de “fotografar” nossas condições iniciais de execução. Na lógica das IAs, precisamos versionar três coisas simultaneamente: o código, os dados e o modelo.

Isso garante a reprodutibilidade, ou seja, a capacidade de qualquer outro desenvolvedor obter o mesmo resultado exato utilizando as mesmas configurações iniciais e gerar condições de explicabilidade do modelo de IA.

8. Eficiência, custos e escalabilidade

Este é elemento central para ampliações de protótipos para projetos em produção. Isso porque treinar modelos de IA exige alto poder computacional e, consequentemente, custos elevados.

Nesse sentido, um pipeline eficiente utiliza orquestradores (como Kubernetes) para alocar recursos apenas quando necessário, garantindo que o sistema suporte milhões de usuários sem comprometer a viabilidade financeira do projeto.

Como o pipeline de IA se integra no produto

Um pipeline não é, ou pelo menos não precisa ser, um módulo isolado em um produto digital. A integração, pode ocorrer em dois níveis principais:

Integração nos pontos de contato com usuário

Sempre que um usuário interage com uma interface no front-end, seja clicando em um botão ou fazendo uma busca, os dados dessa ação entram no pipeline. Em milissegundos, o sistema processa a informação e devolve uma resposta personalizada.

É a diferença entre um aplicativo estático e uma experiência adaptativa que parece "conhecer" as preferências de quem o utiliza.

Conexão com os sistemas existentes

Nesse caso de integração, o pipeline precisa conversar com o banco de dados da empresa para buscar históricos, com as APIs de segurança para validar identidades e com o front-end para apresentar as previsões de forma intuitiva. Essa conexão garante que a IA não seja um "corpo estranho", mas uma ferramenta integrada ao fluxo de valor e regras do negócio.

5 tipos de produtos que usam pipeline de IA

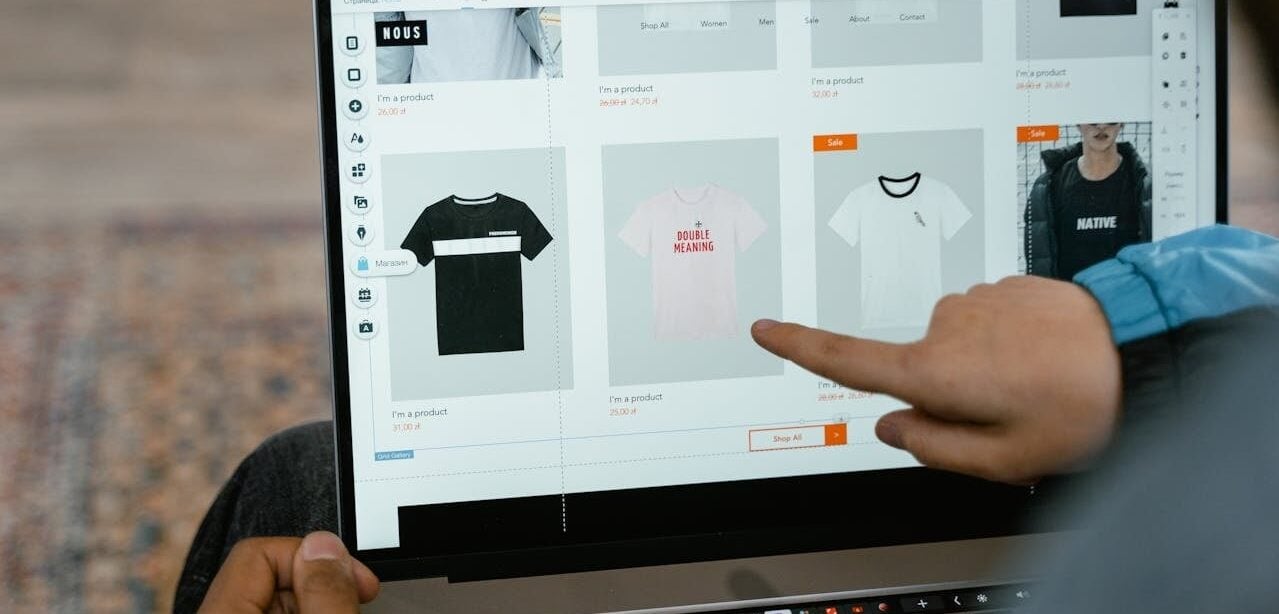

A aplicação prática de pipelines de IA no e-commerce: automatizar a curadoria e recomendação de produtos exige um fluxo de dados bem estruturado, da coleta ao processamento em tempo real.

A aplicação prática dessa estrutura é visível em diversos setores:

- Comunicação e social: redes sociais utilizam pipelines para filtrar spam, moderar conteúdo impróprio automaticamente e organizar o feed de notícias com base no interesse demonstrado pelo usuário.

- E-commerce e varejo digital: sistemas que calculam preços dinâmicos em tempo real e motores de recomendação que sugerem produtos complementares ao carrinho de compras.

- Produtos financeiros: bancos digitais dependem de pipelines rigorosos para aprovação de crédito em segundos e para bloquear transações suspeitas antes mesmo que elas sejam concluídas.

- Saúde e bem-estar: aplicativos que analisam dados de dispositivos vestíveis (wearables) para prever riscos de arritmias ou sugerir ajustes em rotinas de exercícios de forma personalizada.

- Educação: Plataformas de ensino que identificam onde o estudante tem mais dificuldade e ajustam automaticamente a trilha de conteúdo para otimizar o aprendizado.

5 etapas fundamentais do pipeline de IA

Embora existam muitas tarefas técnicas, o fluxo macro pode ser resumido em cinco estágios:

| Etapa | Objetivo | Ação Prática |

| Coleta e tratamento | Obter dados limpos | Remover duplicatas e padronizar formatos de data/moeda. |

| Modelagem | Construir a inteligência | Escolher o algoritmo e realizar o treinamento computacional. |

| Validação | Garantir a precisão | Testar o modelo contra um conjunto de dados de controle. |

| Cálculo e publicação | Colocar em uso | Disponibilizar o modelo via API para o aplicativo final. |

| Monitoramento | Vigiar a performance | Dashboard de acompanhamento de erros e taxa de acerto. |

Pipelines de IA generativa

Pipelines de IA transformam a teoria acadêmica em ferramentas de bolso. Eles são a ponte necessária para levar algoritmos complexos dos livros de referência para a palma da mão dos usuários.

Em 2026, os pipelines para IA generativa (como modelos de linguagem) possuem camadas adicionais.

Além do treinamento base que já discutimos acima, eles incluem o fine-tuning (ajuste fino para uma tarefa específica) e o RLHF (Reinforcement Learning from Human Feedback), onde humanos ajudam a IA a entender quais respostas são mais úteis e seguras no treinamento de linguagem natural. Esses fluxos garantem que o conteúdo gerado não seja apenas criativo, mas também preciso e ético.

Pipeline de agentes de IA

Uma tendência consolidada é o uso de agentes de IA, sistemas autônomos que não apenas respondem perguntas, mas executam tarefas. O pipeline de um agente é multilinear: ele orquestra vários modelos simultaneamente, como se fossem multiagentes de IA.

Aqui na Alura mesmo já falamos de várias formas de uso dessas ferramentas agenticas e inclusive como as criar:

TUTORIAL: aprenda a criar agentes de IA com a CREW AI | IAs Generativas

Um agente pode coletar dados, um segundo modelo planeja a estratégia e um terceiro executa a ação. A orquestração desses pipelines exige guardrails (limites de segurança) muito mais sofisticados para evitar que a IA tome decisões prejudiciais de forma autônoma.

Por que pipelines são importantes?

Já deu para notar que podemos resumir que a importância de investir em pipelines robustos reside na confiabilidade, não é mesmo?

Um modelo de IA sem pipeline geraria um conjunto de instabilidades e cria um cenário mais favorável para falhas, desvios ou excessos no consumo de recursos do projeto.

São os pipelines de IA que garantem que a inteligência do produto seja auditável, permitindo que a empresa explique por que uma decisão foi tomada.

Além disso, eles proporcionam agilidade: se um concorrente lança uma nova funcionalidade, uma empresa com pipelines automatizados consegue retreinar e atualizar seus modelos em horas, enquanto outras levariam semanas de trabalho manual.

Construa o seu futuro na área de inteligência artificial

Dominar a estrutura dos pipelines de IA é o que diferencia um entusiasta de tecnologia de um profissional de engenharia de software de elite. Em 2026, as empresas não buscam apenas quem sabe criar modelos, mas quem sabe mantê-los funcionando com escala e segurança.

A Alura oferece carreiras completas de aprendizado que cobrem desde a base da ciência de dados até as práticas avançadas de MLOps e IA Generativa.

Complemente seu conhecimento técnico com a visão estratégica dos cursos da FIAP, focados em preparar os líderes que orquestrarão as próximas revoluções tecnológicas.

Perguntas frequentes sobre os pipelines de IA

Você ainda ficou com algumas dúvidas depois do conteúdo? Calma, confira abaixo as mais frequentes!

1. Qual a diferença entre pipeline de dados e pipeline de IA?

O pipeline de dados é focado em transporte e transformação de dados (ETL). O pipeline de IA utiliza esses dados como base para construir e servir modelos preditivos que aprendem com o tempo.

2. Preciso ser um cientista de dados para trabalhar com pipelines?

Não. Grande parte da construção de pipelines envolve engenharia de dados, infraestrutura de nuvem e DevOps. É um trabalho multidisciplinar que exige colaboração entre diferentes perfis técnicos.

3. Como garantir que a IA não seja tendenciosa no pipeline?

A redução de viés deve acontecer nas etapas de coleta (garantindo diversidade nos dados) e validação (utilizando métricas de equidade para testar o comportamento do modelo em diferentes grupos).

4. O pipeline de IA pode ser executado localmente?

Sim, para testes e protótipos. No entanto, para escala industrial e integração com milhões de usuários, a infraestrutura em nuvem é necessária devido à necessidade de alta disponibilidade e poder de processamento.

5. Qual a ferramenta mais comum para orquestrar esses pipelines?

Em 2026, orquestradores como o Kubernetes, em conjunto com ferramentas específicas de ML como Kubeflow ou instâncias gerenciadas em provedores de nuvem, são o padrão de mercado.

6. Como medir o retorno sobre o investimento (ROI) de um pipeline?

O ROI é medido pela redução de erros operacionais, pela velocidade de atualização dos modelos e pela capacidade de manter a inteligência do produto funcionando sem a necessidade de uma equipe gigante de suporte manual.

7. O que acontece se os dados de treinamento forem excluídos?

Isso quebra a reprodutibilidade. Sem os dados originais, é impossível auditar por que o modelo tomou certas decisões ou retreiná-lo com as mesmas configurações, por isso o versionamento de dados é uma etapa obrigatória.