Databricks: o que é e para que serve?

Com o aumento exponencial da quantidade de dados gerados nos últimos anos, tornou-se essencial encontrar maneiras eficientes de gerenciar e processar esses dados em larga escala. Nesse contexto, o Databricks se posiciona como uma ferramenta crucial para a análise de dados em tempo real, aprendizado de máquina e processamento distribuído de dados, se destacando pelo seu desempenho otimizado e facilidade de uso. Neste artigo, iremos explicar mais sobre esta ferramenta e entender melhor sua importância no meio de dados.

Origem do Databricks

O Databricks foi criado em 2013 por um grupo de engenheiros que trabalhavam juntos no laboratório de inteligência artificial da Universidade da Califórnia em Berkeley. Esses engenheiros foram os mesmos responsáveis pelo desenvolvimento do Apache Spark, um motor de processamento distribuído de dados em larga escala, que se tornou muito popular entre as empresas de tecnologia. A ideia de criar o Databricks surgiu da necessidade de oferecer uma plataforma mais fácil de usar e mais amigável para o Apache Spark, que pudesse atender às demandas cada vez maiores das empresas por análise de dados em tempo real e aprendizado de máquina.

Se você quiser saber mais sobre o Apache Spark e sua relação com grandes volumes de dados, ou big data, vale conferir esse vídeo do Bruno Raphaell:

https://www.youtube.com/watch?v=3aSfKsBhU5E

O que é o Databricks?

Para gerenciar e processar seus dados em larga escala, as equipes de dados muitas vezes precisavam trabalhar com várias ferramentas diferentes. Essas ferramentas eram complexas e difíceis de usar, exigindo habilidades avançadas de programação e conhecimento profundo de bancos de dados e tecnologias de armazenamento.

Surge então a plataforma do Databricks como uma solução de computação em nuvem que pode ser usada para processamento, transformação e exploração de grandes volumes de dados. Ela foi projetada para permitir que os usuários se concentrem em análises de dados avançadas e na tomada de decisões baseadas em dados, de uma forma mais simples.

A plataforma é altamente escalável e pode ser configurada para trabalhar com vários serviços em nuvem, incluindo Amazon Web Services (AWS), Microsoft Azure e Google Cloud Platform.

Como funciona o Databricks?

O Databricks foi construído em cima do Apache Spark e utiliza clusters para o processamento de grandes volumes de dados de forma distribuída, o que a torna uma ferramenta eficiente e escalável. Ela possibilita ao próprio usuário utilizar sua interface simples para gerenciar seus clusters.

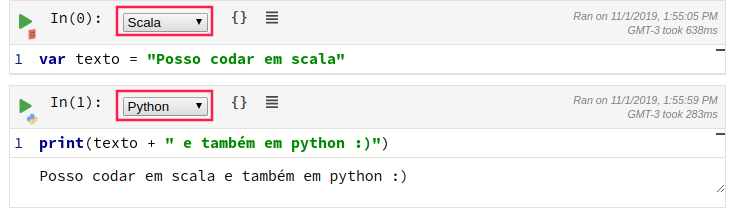

Para usar a plataforma Databricks, os usuários criam notebooks, que são documentos interativos que permitem escrever e executar código para processar dados. Os notebooks podem incluir código em várias linguagens de programação, como Python, R e SQL.

Além disso, a plataforma também possui recursos para construção de pipelines, permitindo que os usuários processem dados em etapas e visualizem os resultados em tempo real. Em resumo, o Databricks é uma plataforma de processamento de dados flexível e eficiente que oferece uma variedade de ferramentas para ajudar as empresas a processar e analisar dados.

Casos de uso

Várias empresas passaram a utilizar essa ferramenta no dia a dia, por trazer mais performance e produtividade, empresas como PicPay, HSBC, SEGA e Shell são algumas que utilizam a plataforma para trabalhar com grandes conjuntos de dados onde a rapidez e escalabilidade são essenciais. É comum encontrar o uso desta plataforma em alguns casos de uso:

1. Análise exploratória

O Databricks permite que os analistas de dados possam explorar grandes conjuntos de dados, aplicando análises e visualizações com bibliotecas já instaladas, combinando, por exemplo, SQL e Python para explorar dados.

2. Machine learning

Databricks oferece suporte para construção de modelos de machine learning em grande escala, de forma colaborativa entre equipes, permitindo cuidar de todo ciclo do ML, desde o treinamento até a implantação do produto final.

3. Processamento de dados em lote ou em tempo real

Você pode processar os dados, e montar todo ciclo de ETL, fazendo análises e processamento de fluxos de dados de forma contínua (Streaming) ou em lote.

No caso da Shell, o Databricks democratizou o acesso aos dados e também promoveu uma maior colaboração entre equipes de engenharia, ciência e análise de dados. Hoje, a empresa utiliza o Databricks para executar análises e implantar modelos de Machine Learning. No site do Databricks, você pode ler em inglês a história completa da Shell com a ferramenta Databricks.

Em resumo, o Databricks é uma ferramenta essencial para quem trabalha com engenharia de dados e análise de dados em geral, que permite tornar o processo de coleta, processamento e análise de dados mais eficiente, escalável e fácil de realizar. Com seu crescimento constante, é uma plataforma que deve ser levada em consideração por quem deseja estar sempre atualizado e preparado para as demandas do mercado de dados.

Caso você tenha interesse e queira aprender ainda mais sobre Databricks, você pode aprender aqui na Alura com o curso Databricks: conhecendo a ferramenta, que apresenta os conceitos iniciais da plataforma.

Créditos:

- Conteúdo: Paulo Calanca

- Produção técnica: Rodrigo Dias

- Produção didática: Thaís de Faria