LangFlow: O que é, como instalar e como criar seu primeiro projeto

Já imaginou criar um agente de IA em poucos minutos? E sem precisar escrever dezenas de linhas de código? Durante muito tempo, isso parecia algo reservado a quem dominava bibliotecas complexas e arquiteturas sofisticadas. Mas ferramentas como o LangFlow mudaram esse cenário.

Pense nele como um verdadeiro Lego com um monte de peças disponíveis, você conecta os blocos e vê sua aplicação ganhar vida diante dos seus olhos. Neste artigo, você vai entender o que é o LangFlow e por que ele tem se tornado uma escolha estratégica nos dias atuais.

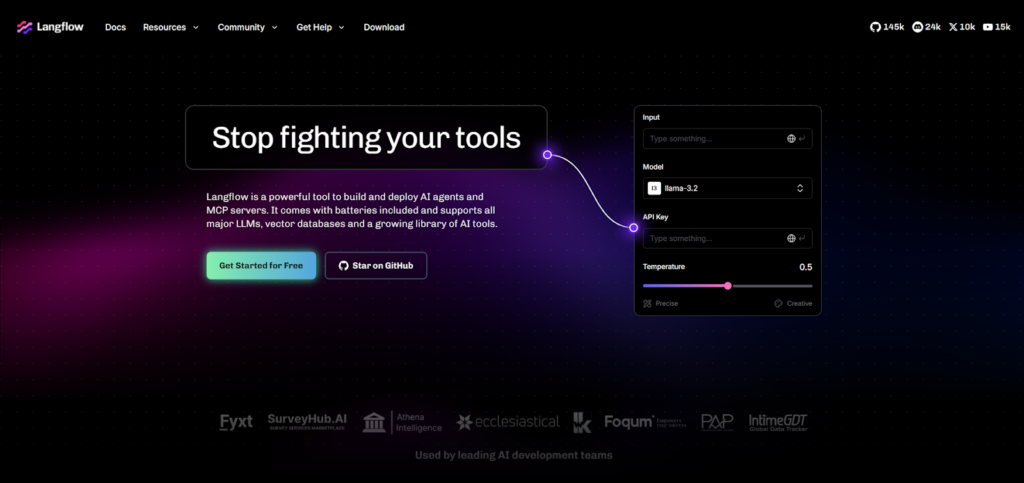

O que é o LangFlow?

Página inicial do LangFlow

O LangFlow é uma plataforma que permite criar agentes e aplicações de Inteligência Artificial de maneira muito intuitiva e visual, funcionando como um ambiente de arrastar e soltar blocos chamados de componentes.

Em sua essência, é uma ponte entre a complexidade das bibliotecas de IA e a simplicidade de uma interface gráfica acessível.

Por que usar o LangFlow?

Utilizar o LangFlow significa acelerar o desenvolvimento de soluções em IA, reduzindo barreiras técnicas e aumentando a produtividade. Ele oferece integração com modelos de linguagem, ferramentas de busca e bancos de dados, permitindo que você crie protótipos funcionais em minutos.

Além disso, sua interface facilita a colaboração entre equipes multidisciplinares, já que é possível criar e configurar fluxos de trabalho sem necessariamente escrever código, incentivando a contribuição de todos os membros.

Como instalar o LangFlow?

Existem duas formas de instalação:

- Via Python (ideal para desenvolvimento local)

- Via Docker (ideal para isolamento e ambientes organizados)

Passo a passo para instalar via Python

1. Pré-requisito

Você precisa ter:

- Python 3.10 ou superior instalado

- pip instalado

Como instalar o Python? Veja esse material aqui: Primeiros passos com o Python

Para verificar a sua versão do Python, execute no terminal:

python --versionE para verificar a sua versão do pip, execute no terminal:

pip --version2. Crie um ambiente virtual (recomendado)

Criar um ambiente virtual evita conflitos com outros projetos, execute no terminal:

python -m venv venvEm seguida, ative o ambiente assim:

No Windows

venv\Scripts\activateNo Linux ou macOS

source venv/bin/activate3. Instale o LangFlow

Agora instale o LangFlow via pip:

python -m pip install langflowAguarde o download e instalação das dependências.

4. Execute o LangFlow

Depois de instalado, execute no terminal:

langflow runO terminal exibirá algo como:

[OK] Open Langflow -> http://localhost:7860Abra esse endereço no navegador e pronto! A interface visual já estará disponível.

Passo a passo para instalar via Docker

1. Pré-requisito

Você precisa ter:

- Docker Desktop instalado

Como instalar o Docker? Veja esse material aqui: Instalação do Docker Desktop (siga até a etapa 10 somente).

Para verificar a sua versão do Docker, execute no terminal:

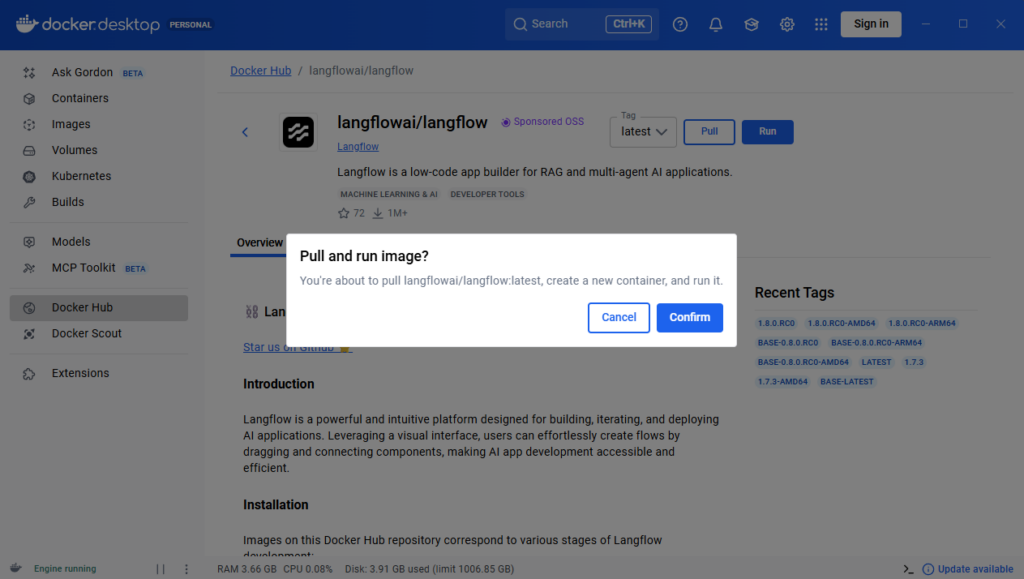

docker --version2. Baixe e execute a imagem do LangFlow no Docker

Acesse a imagem oficial do LangFlow no site: https://hub.docker.com/r/langflowai/langflow.

Na página que abrir:

- Selecione a tag latest

- Clique no botão Run in Docker Desktop

- Em seguida, uma caixa de diálogo irá ser exibida no Docker Desktop, clique em Confirm para baixar e rodar o LangFlow.

Caixa de diálogo no Docker Desktop

Aguarde o processo de download, pode levar um tempo dependendo da conexão.

3. Abrindo o LangFlow no navegador

Por fim, abra o seguinte endereço no navegador: http://localhost:7860

Como criar o seu primeiro fluxo no LangFlow

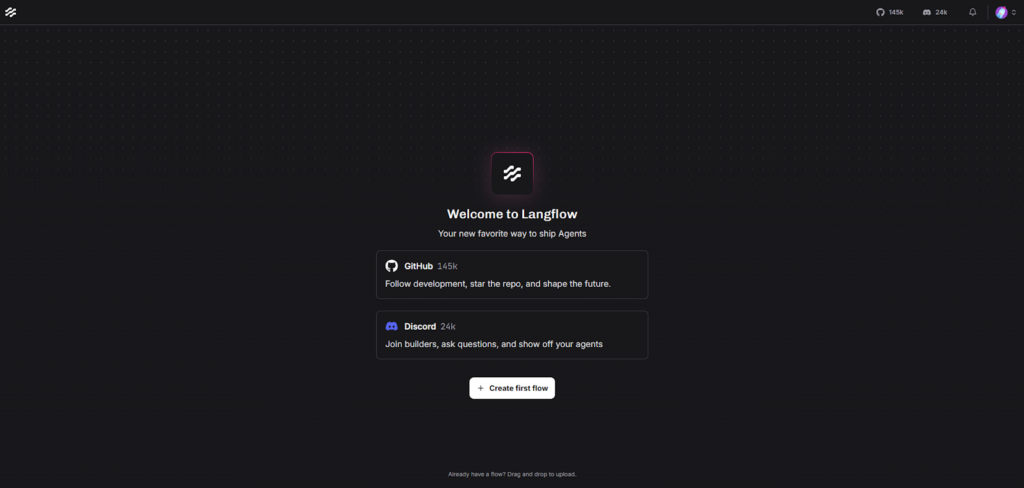

Acesse a interface do LangFlow

Ao abrir o endereço indicado nas etapas acima, a interface inicial do LangFlow é exibida:

Tela inicial do LangFlow

Nesse momento, clique no botão Create first flow.

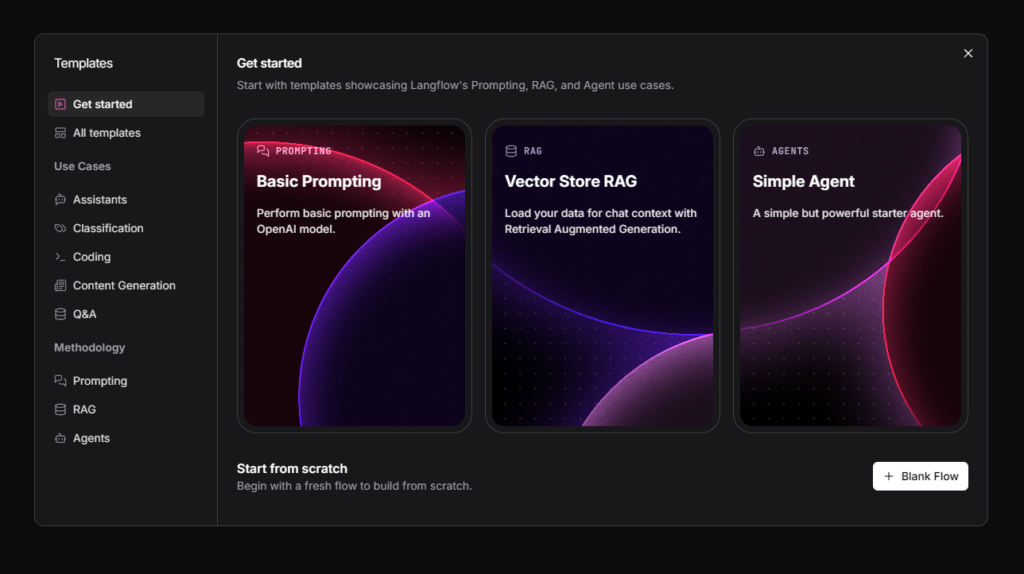

Nomeie e prepare o fluxo

Agora, temos a opção de iniciar um fluxo do zero clicando no botão Blank Flow ou optar por alguns fluxos de exemplo. Para esse artigo, vamos clicar no fluxo Basic Prompting, que já adianta algumas etapas iniciais.

Criação de fluxo no LangFlow

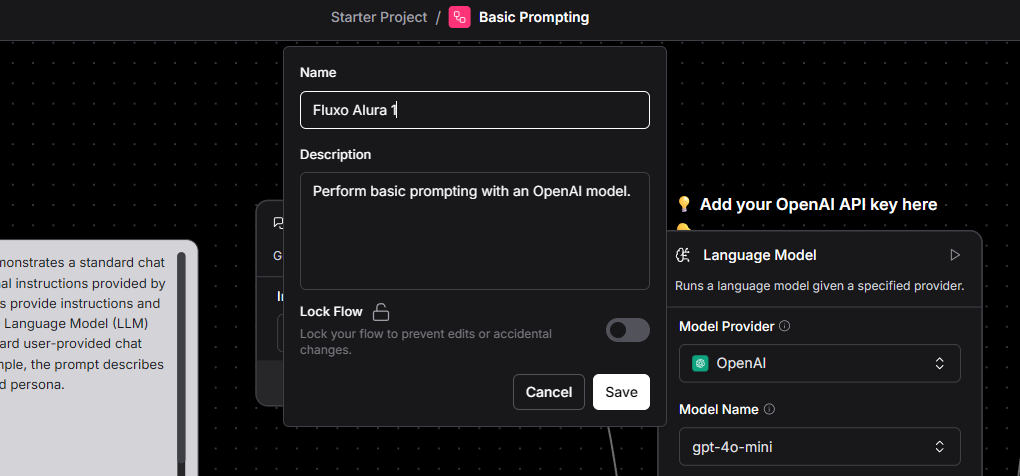

Repare que, no topo da interface, o nosso projeto está nomeado como Basic Prompting. Vamos renomeá-lo, para isso, basta clicar no nome atual e digitar outro. Por fim, clique em Save.

Interface de fluxo no LangFlow

Integre modelos de linguagem (LLM)

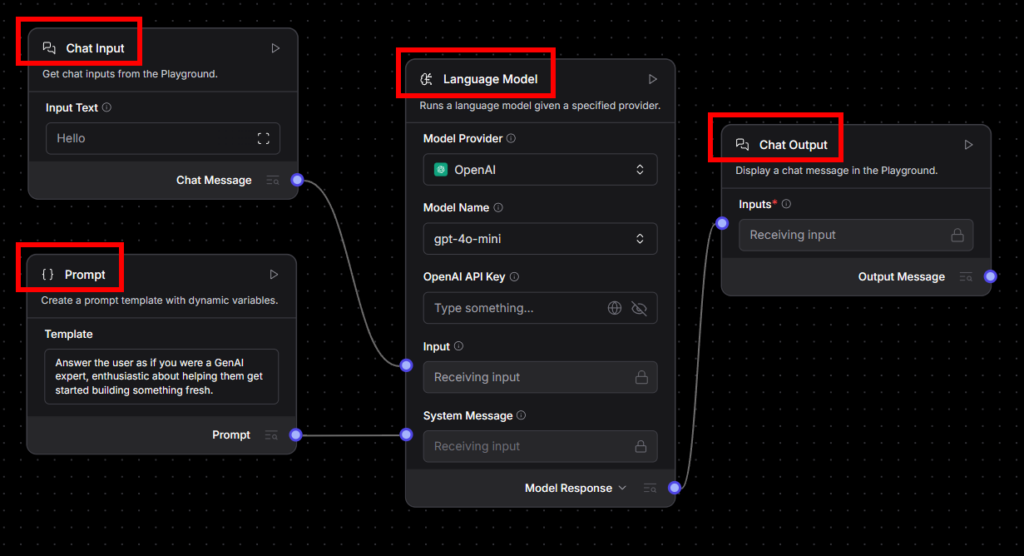

Repare que no nosso fluxo existem 4 componentes:

- Prompt

- Chat Input

- Chat Output

- Language Model

Exemplo de fluxo no LangFlow

Nós temos um modelo de linguagem integrado no nosso fluxo por meio do componente Language Model, mas é necessário configurá-lo. Para isso, siga as etapas:

- Em Model Provider, selecione a opção Google.

- Em Model Name, selecione a opção gemini-2.5-flash.

- Em Google API Key, cole uma API Key da Google. Você pode gerar uma aqui: https://aistudio.google.com/u/1/api-keys

E pronto, configuramos um modelo Gemini ao nosso fluxo no LangFlow. Uma observação: As chaves de API podem exceder o limite de uso gratuito com o tempo, sendo necessário criar outros projetos com outras chaves no Google AI Studio futuramente.

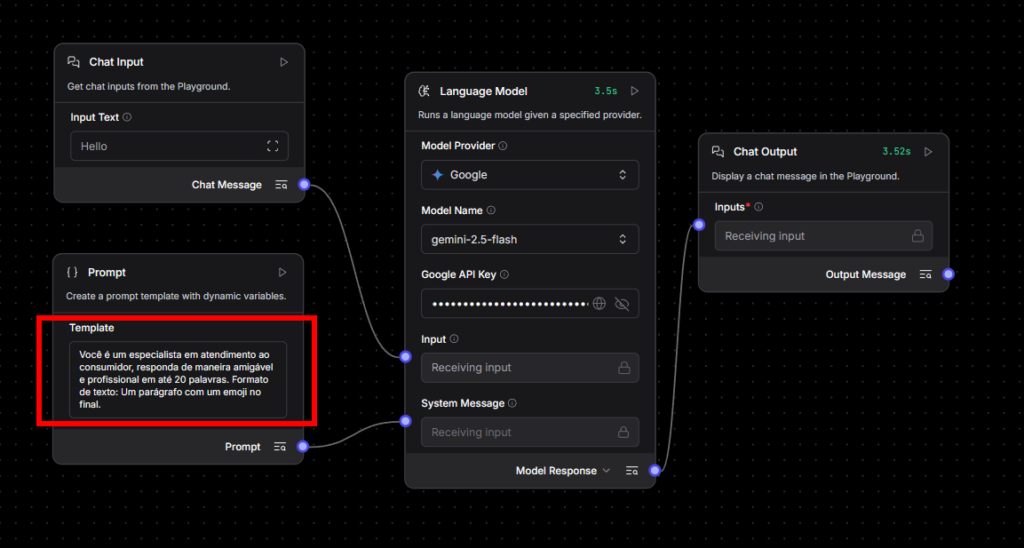

Crie um prompt eficaz

O nosso fluxo representa um agente de IA que irá responder ao chat, logo é importante configurar o componente Prompt para responder de acordo com o nosso objetivo. Clique no campo Template e substitua o texto por esse prompt:

Você é um especialista em atendimento ao consumidor, responda de maneira amigável e profissional em até 20 palavras. Formato de texto: Um parágrafo com um emoji no final.

Por fim, clique em Check & Save. O nosso prompt é eficaz porque define o papel do modelo de linguagem (especialista em atendimento ao consumidor). Além disso, definimos a tarefa (responder de maneira amigável e profissional) e definimos o formato da resposta (um parágrafo com um emoji no final).

Alteração do prompt no fluxo do LangFlow

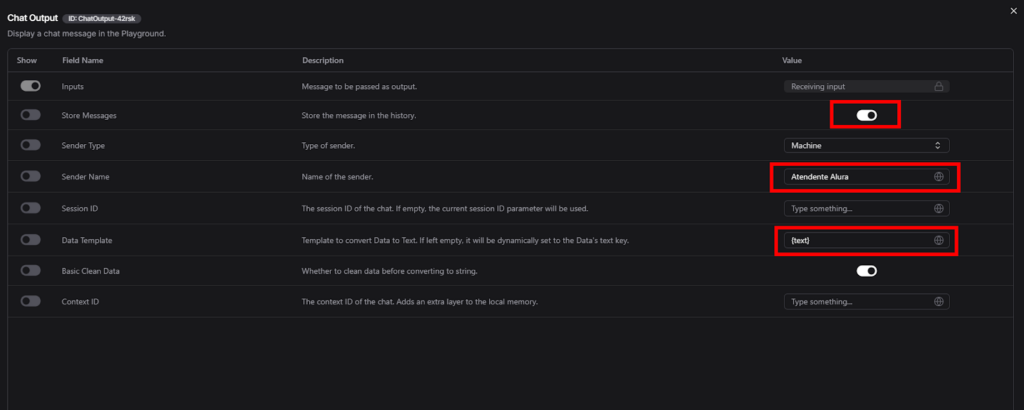

Configure o componente de saída da pessoa usuária

O componente responsável pela saída de resposta do chat é o componente Chat Output, clique nele e depois selecione a opção Controls. Nessa janela, podemos realizar as seguinte configurações:

- No campo Sender Name, altere o valor de AI para Atendente Alura.

- No campo Store Messages, certifique-se que o valor esteja ligado.

- No campo Data Template, certifique-se que esteja o valor {text}.

Controles do componente Chat Output

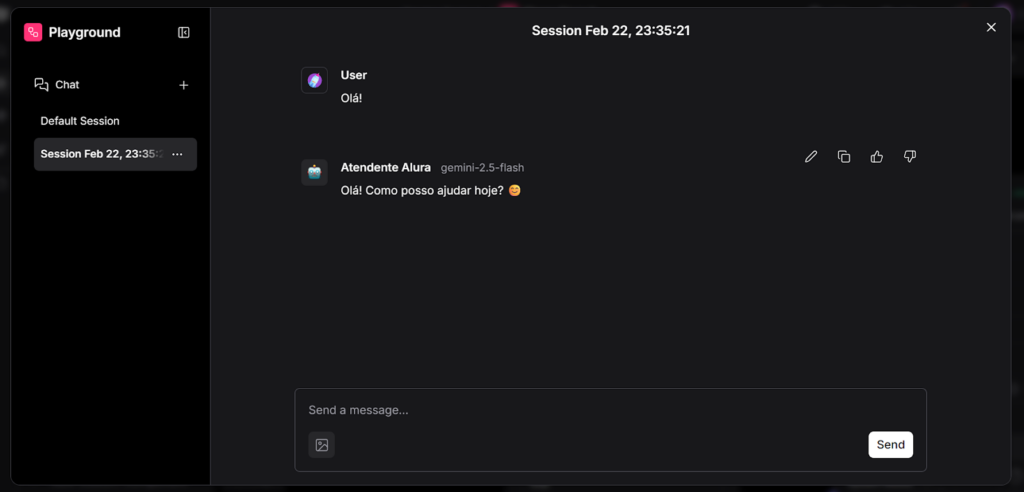

Teste o fluxo

Chegou o tão esperado momento, vamos ver o nosso agente de IA funcionando! Para isso:

- Clique no botão Playground.

- Digite uma mensagem do tipo “Olá!” e clique em Send.

- Se tudo estiver correto, você verá a resposta do nosso atendente.

Playground do LangFlow

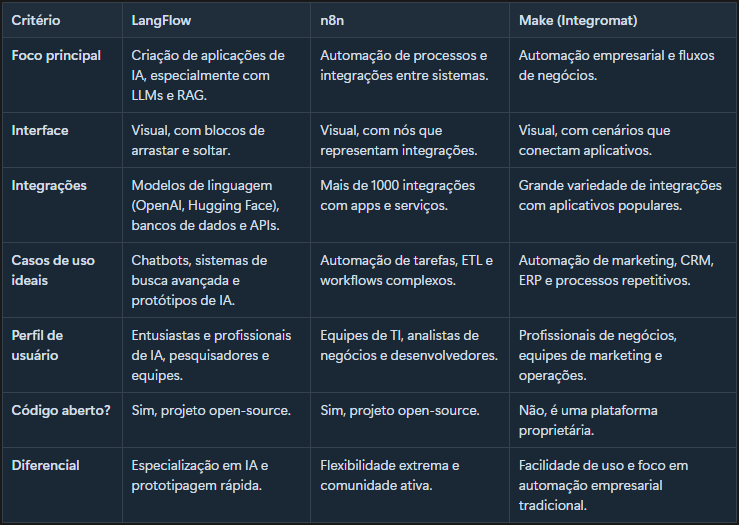

Comparando o Langflow com outras ferramentas

LangFlow vs n8n

O LangFlow é voltado para quem deseja criar aplicações de Inteligência Artificial com foco em modelos que trabalham com processamento de texto, oferecendo uma interface visual para montar fluxos de agentes.

Já o n8n é uma ferramenta de automação de propósito geral, que se destaca pela enorme quantidade de integrações (mais de 1000 apps) e pela flexibilidade em conectar sistemas de negócios.

Enquanto o LangFlow brilha em prototipagem rápida de soluções de IA e workflows de LLM, o n8n é mais indicado para quem busca automação de processos corporativos e integrações complexas entre diferentes serviços.

LangFlow vs Make

O Make (antigo Integromat) é uma plataforma de automação no-code que se destaca pela ampla variedade de integrações e pela facilidade em criar fluxos de negócios sem precisar programar. Ele é ideal para conectar aplicativos, automatizar tarefas repetitivas e orquestrar processos empresariais.

O LangFlow, por outro lado, é mais especializado em aplicações de IA, especialmente em prototipagem de soluções com LLMs e RAG.

Enquanto o Make é uma escolha natural para automação empresarial tradicional, o LangFlow se posiciona como a ferramenta para quem quer explorar o poder da inteligência artificial em fluxos personalizados.

Tabela Comparativa: LangFlow x n8n x Make

Casos de uso do LangFlow

Para criar chatbots

Com o LangFlow, é possível estruturar chatbots inteligentes que entendem todo o contexto, respondem de forma natural e podem se conectar a APIs externas. Isso torna a criação de assistentes virtuais mais ágil, seja para atendimento ao cliente, suporte técnico ou experiências interativas em sites e aplicativos.

Para criar aplicações em RAG

O LangFlow também é muito usado em aplicações de Retrieval-Augmented Generation (RAG), nas quais o modelo de linguagem consulta bases de dados ou documentos antes de responder. Isso garante respostas mais precisas e atualizadas, ideais para sistemas de busca avançada, análise de documentos corporativos ou plataformas de conhecimento interno.

Por que aprender LangFlow?

Aprender sobre o LangFlow é investir em uma habilidade estratégica para o futuro da tecnologia. Ele democratiza o acesso ao desenvolvimento em IA, permitindo que profissionais de diferentes áreas criem soluções inovadoras sem depender exclusivamente de programadores.

Além disso, dominar essa ferramenta abre portas para explorar aplicações práticas de inteligência artificial em negócios, educação, pesquisa e muito mais.

Como aprender mais sobre LangFlow?

Se você quer dar o próximo passo na sua jornada em Inteligência Artificial, as carreiras de IA da Alura são o caminho ideal.

Você começa pela base com os primeiros passos em programação para IA e avança por níveis que incluem automação com n8n, construção de chatbots com RAG, criação de agentes inteligentes com LangGraph e muito mais.

Outro destaque é o curso LlamaIndex: criando um chatbot com a técnica RAG, que aborda diretamente o uso do LangFlow para prototipar soluções reais.

Uma oportunidade prática e sequencial para aprender IA de forma aplicada, evoluindo de iniciante a especialista com o suporte de uma comunidade engajada e conteúdos atualizados.

FAQ | Perguntas frequentes sobre LangFlow

1. O LangFlow é uma ferramenta de código aberto ou proprietária?

O LangFlow é um projeto de código aberto, o que significa que qualquer pessoa pode explorar, contribuir e adaptar a ferramenta conforme suas necessidades. Isso garante maior transparência e flexibilidade para desenvolvedores e empresas.

2. Preciso saber programar para usar o LangFlow?

Não necessariamente. Embora conhecimentos básicos de lógica e programação ajudem, o LangFlow foi projetado para ser usado por pessoas de diferentes perfis. Sua interface gráfica facilita a criação de protótipos sem exigir código complexo, mas também permite que desenvolvedores avancem com integrações mais técnicas.

3. O LangFlow pode ser integrado com outras plataformas e serviços?

Sim, ele foi pensado para se conectar com APIs externas, bancos de dados e modelos de linguagem como o OpenAI ou Hugging Face. Essa capacidade de integração amplia as possibilidades de uso, permitindo criar soluções personalizadas e adaptadas a diferentes cenários.

4. O LangFlow substitui outras ferramentas de IA, como LangChain?

Na verdade, o LangFlow complementa ferramentas como o LangChain. Ele oferece uma camada visual sobre bibliotecas já existentes, permitindo que você configure fluxos de forma mais intuitiva. Assim, pode ser visto como uma porta de entrada prática para explorar o ecossistema de IA.

5. Existe uma comunidade ativa em torno do LangFlow?

Sim, há uma comunidade crescente de usuários e desenvolvedores que compartilham exemplos, tutoriais e melhorias. Participar dessa comunidade é uma ótima forma de aprender mais rápido, trocar experiências e até contribuir para a evolução da ferramenta.